金融科技转型浪潮下,数据架构的演进之路 夯实数据处理与存储支持服务

随着人工智能、区块链、云计算等技术的深度融合,金融科技转型正以前所未有的速度重塑行业格局。这场深刻的变革不仅带来了效率提升与模式创新,更引爆了数据规模激增、处理实时性要求提高、安全与合规压力陡增等一系列新挑战。传统的数据架构在应对这些挑战时往往力不从心,因此,对数据架构进行系统性升级,构建强大、敏捷、安全的数据处理与存储支持服务体系,已成为金融机构在数字化浪潮中保持竞争力的核心课题。

一、 直面转型挑战:数据架构升级的必然性

金融科技的蓬勃发展,催生了海量、多元、高速产生的数据。从高频交易、实时风控到个性化营销、智能投顾,业务场景对数据的实时处理与分析能力提出了极高要求。日趋严格的全球数据安全法规(如GDPR、国内《数据安全法》《个人信息保护法》)使得数据治理与合规成为生命线。传统以批量处理为主的数仓架构,存在数据处理链路长、实时性差、扩展性不足、运维成本高等瓶颈,难以支撑敏态业务创新与严格的合规监管需求。数据架构升级已从“可选项”变为“必选项”。

二、 架构升级核心路径:构建面向未来的数据处理与存储支柱

数据架构的升级并非简单的技术堆砌,而应围绕业务价值与合规要求,进行整体规划与分步实施。其核心在于构建一个能够兼顾效率、弹性、智能与安全的现代化数据处理与存储支持服务体系。

- 向云原生与混合多云架构演进:采用容器化、微服务、Serverless等云原生技术,构建弹性可扩展的数据平台基础。混合多云策略可以帮助金融机构灵活利用不同云服务商的优势,在保证核心数据主权与安全的前提下,实现资源的最优配置与成本控制,并为数据处理服务提供近乎无限的弹性伸缩能力。

- 拥抱流批一体与实时数据处理:引入Apache Flink、Spark Streaming等流处理框架,构建流批一体的数据处理引擎。这允许机构在同一套架构中同时处理实时数据流和历史批量数据,将数据洞察的延迟从小时级、天级降低到秒级甚至毫秒级,为实时反欺诈、即时信贷审批、市场情绪分析等场景提供强大支撑。

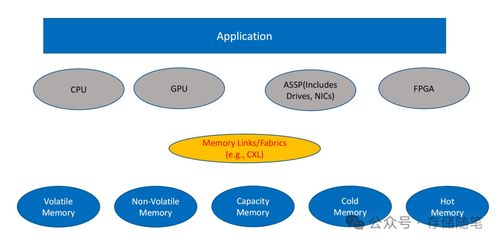

- 实现数据湖仓一体的智能存储:超越传统数仓与数据湖的界限,建设融合两者优势的“湖仓一体”(Lakehouse)平台。它既能像数据湖一样以低成本存储海量原始数据(包括结构化、半结构化和非结构化数据),又能像数据仓库一样提供高效、可靠的数据管理和SQL分析性能。结合数据目录、元数据管理工具,实现数据的可发现、可理解、可信任,为上层AI/ML模型训练与高级分析提供高质量“燃料”。

- 强化数据治理与安全合规能力:将数据治理与安全能力内嵌于架构之中。通过数据资产地图、数据血缘分析、数据质量监控等手段,实现全链路的数据可观测性。应用同态加密、差分隐私、数据脱敏、细粒度访问控制等技术,在数据采集、传输、存储、计算、销毁的全生命周期贯彻“隐私计算”与“安全合规”理念,满足监管要求并赢得客户信任。

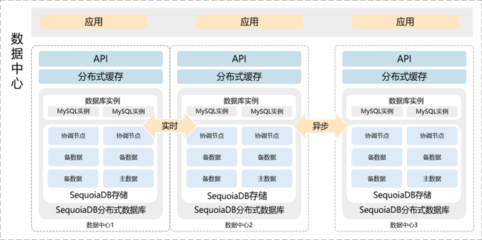

- 提供全域统一的数据服务层:在底层强大的处理与存储能力之上,构建统一、自助式的数据服务层(Data API)。通过将数据能力封装成标准化的API服务,安全、高效地赋能给前台的各类业务应用、分析工具与合作伙伴,促进数据资产的价值流通与业务创新,实现从“数据平台”到“数据服务”的转变。

三、 实施策略与未来展望

数据架构升级是一项系统工程,建议采取“整体规划、分域实施、迭代演进”的策略。优先从对业务价值提升明显或合规压力最大的场景切入,例如实时风控或客户360视图,快速验证新架构的价值。重视组织文化与人才技能的同步转型,培养兼具金融业务知识与数据技术的复合型团队。

随着量子计算、边缘计算等前沿技术的发展,金融数据架构将进一步向分布式、智能化、边缘化演进。但万变不离其宗,其核心使命始终是:构建一个能够将数据资源高效、安全、合规地转化为业务洞察与驱动力的坚实基座。只有持续升级数据架构,夯实数据处理与存储支持服务,金融机构才能在金融科技转型的浪潮中行稳致远,赢得未来。

如若转载,请注明出处:http://www.quickagrade.com/product/89.html

更新时间:2026-06-03 04:48:19