数据治理的框架与核心内容 数据处理与存储支持服务解析

数据治理已成为现代企业数字化转型和智能化升级的关键基石。一个完善的数据治理体系不仅关乎数据的质量与安全,更是将数据转化为战略资产、驱动业务创新的核心保障。本文将系统阐述数据治理的通用框架及其核心内容,并重点剖析作为基础支撑的数据处理与存储服务在这一体系中的角色与实施要点。

一、数据治理的总体框架

一个典型的数据治理框架通常包含以下核心层次:

- 战略与组织层:明确数据治理的目标、愿景和原则,建立包括数据治理委员会、数据所有者、数据管家等在内的组织架构与职责体系。

- 政策与标准层:制定统一的数据管理政策、数据标准(如数据模型、元数据、主数据、数据质量等标准)以及合规性要求。

- 流程与活动层:定义覆盖数据全生命周期的管理流程,如数据的创建、存储、处理、集成、使用、归档与销毁。

- 技术与平台层:提供实现上述政策、标准与流程的技术工具与平台支持,这是数据治理得以落地实施的物理基础。

二、数据治理的核心内容

核心内容贯穿于框架的各个层次,主要包括:

- 数据质量管理:确保数据的准确性、完整性、一致性、时效性和可靠性,建立度量、监控、分析与改进的闭环。

- 数据资产管理:对数据资产进行盘点、分类、估值与运营,实现数据价值的最大化。

- 数据标准管理:统一数据定义、格式和编码,消除歧义,促进数据共享与集成。

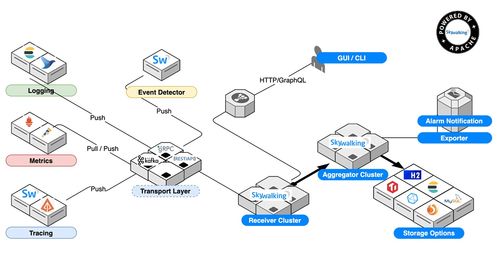

- 元数据管理:管理“关于数据的数据”,提供数据的上下文信息,支持数据发现、理解、血缘追踪和影响分析。

- 主数据管理:确保核心业务实体(如客户、产品、供应商)数据在整个组织内具有一致、准确、权威的“黄金版本”。

- 数据安全与隐私保护:通过数据分类分级、访问控制、加密、脱敏、审计等手段,保障数据安全,满足法律法规(如GDPR、个人信息保护法)要求。

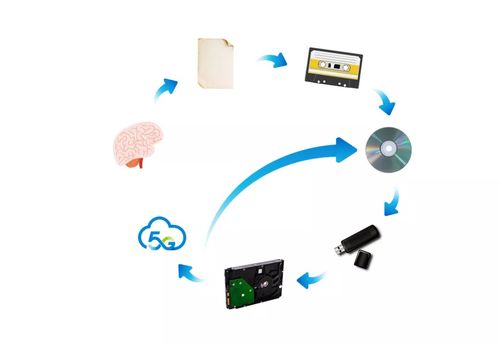

- 数据生命周期管理:根据数据价值、合规要求制定从创建到销毁的全过程管理策略。

三、数据处理与存储支持服务的核心地位

数据处理和存储支持服务是技术与平台层的核心组成部分,是承载所有数据治理活动的基础设施。其核心目标是为高质量、安全、合规的数据提供高效、可靠、可扩展的“栖息地”和“加工厂”。

1. 数据处理服务:

* 角色:负责数据的清洗、转换、集成、计算与分析。它是将原始数据转化为可信、可用信息的枢纽。

- 治理集成:

- 嵌入质量规则:在ETL/ELT流程中内置数据质量检查与清洗规则,实现“在管道中治理”。

- 支持标准落地:通过数据处理逻辑强制执行数据标准(如格式统一、代码转换)。

- 实现血缘可溯:记录数据处理任务的输入、输出和转换逻辑,为元数据管理和影响分析提供关键信息。

- 保障处理安全:在数据处理过程中实施敏感数据脱敏、加密等安全措施。

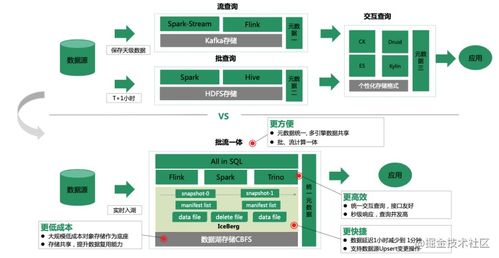

- 典型服务:批处理与流处理引擎、数据集成工具、数据质量工具、ETL/ELT平台、数据计算框架(如Spark、Flink)等。

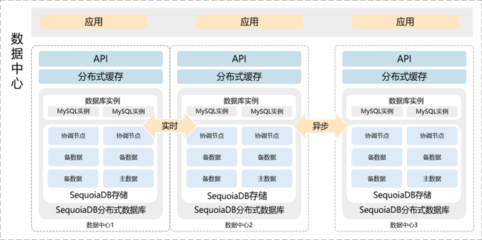

2. 数据存储服务:

* 角色:为不同类别、不同热度的数据提供安全、可靠、成本优化的存储介质与环境。

- 治理集成:

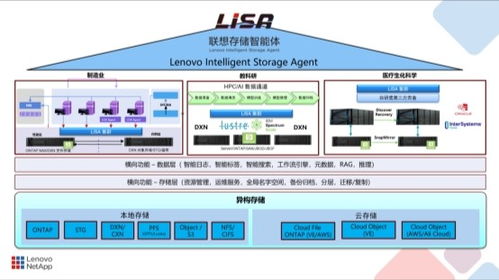

- 支撑分类分级存储:根据数据的安全级别、访问频率和价值,将数据存储于相应的介质(如高速在线存储、低成本对象存储、归档存储)中,并实施差异化的安全策略。

- 实现生命周期管理:与策略联动,自动化执行数据的迁移、归档与销毁操作。

- 强化访问控制:在存储层实施精细化的身份认证与权限管理(如RBAC),防止未授权访问。

- 保障存储安全:提供静态数据加密、完整性校验、备份与容灾能力。

- 支持多模数据:容纳结构化、半结构化和非结构化数据,满足多样化数据管理需求。

- 典型服务:关系型数据库、NoSQL数据库、数据仓库、数据湖、对象存储、分布式文件系统等。

四、实施关键与未来展望

将数据处理与存储服务有效融入数据治理体系,需注意:

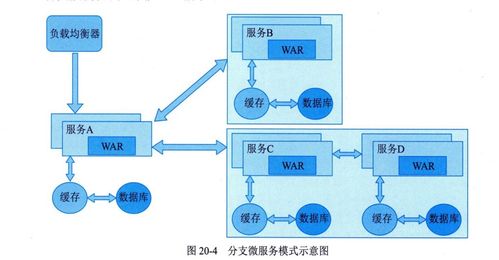

- 架构协同:数据处理与存储架构的设计需与数据治理战略、数据架构(如分层设计)保持一致。

- 元数据驱动:建立统一的元数据管理,自动从处理任务和存储系统中采集技术元数据和操作元数据,形成完整的数据地图。

- 自动化与智能化:利用自动化脚本、策略引擎和AI技术,实现质量检查、标准执行、安全策略、生命周期管理等任务的自动化,提升治理效率。

- 云原生与一体化平台:越来越多的组织采用云原生的数据处理与存储服务,以及集成了治理能力的一体化数据平台(如Data Fabric、Data Mesh理念下的平台),以增强敏捷性、弹性与统一管控能力。

数据处理与存储支持服务是数据治理从蓝图变为现实的工程基础。它们不仅是数据的“容器”与“引擎”,更是治理策略得以技术化、流程化、自动化执行的关键载体。只有将治理要求深度嵌入到这些基础服务的设计与运行中,才能构建出真正健壮、可信、高效的数据环境,从而充分释放数据的商业价值。

如若转载,请注明出处:http://www.quickagrade.com/product/73.html

更新时间:2026-05-28 06:02:44